Система допомоги водієві Full Self-Driving (FSD) від Tesla опинилася під посиленим контролем регуляторів у США. Національна адміністрація безпеки дорожнього руху розширила розслідування через підозри, що технологія не завжди вчасно попереджає водіїв про необхідність втручання.

Йдеться про один із найважливіших продуктів Tesla, який має стати основою майбутніх безпілотних сервісів компанії, зокрема роботаксі.

Чому розслідування перейшло у фінальну стадію

За інформацією Reuters, NHTSA перевела перевірку системи автопілота(FSD) у фазу інженерного аналізу — це завершальний етап перед можливим відкликанням автомобілів. Розслідування охоплює приблизно 3,2 мільйона транспортних засобів Tesla у США.

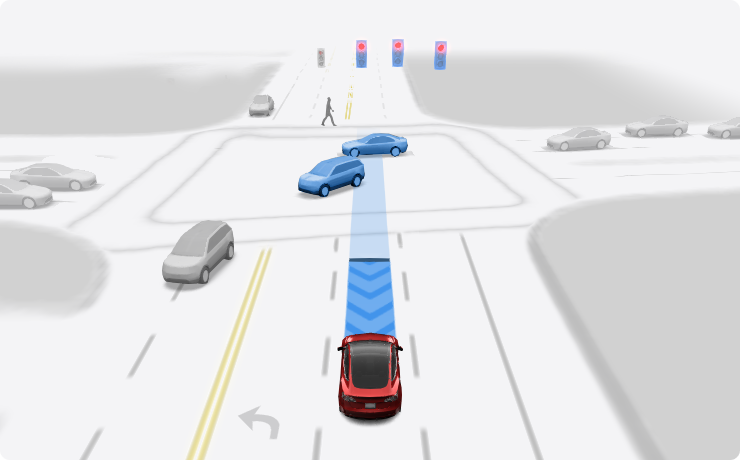

Основна мета — з’ясувати, чи система коректно реагує на складні умови видимості та чи здатна своєчасно попереджати водія про необхідність взяти керування на себе.

У чому полягає проблема автопілота

Ключовим елементом перевірки є система визначення погіршення видимості, яка має фіксувати ситуації, коли камери не здатні коректно розпізнавати дорожню обстановку — зокрема під час яскравих відблисків, у запиленому чи задимленому середовищі, а також за складних погодних умов.

Водночас попередні результати розслідування свідчать, що система не завжди працює належним чином: вона може не розпізнавати небезпечні умови, запізно попереджати водія або взагалі не сигналізувати про ризик, через що в окремих випадках попередження з’являлося безпосередньо перед аварією або було відсутнє.

Аварії та наслідки

За даними регулятора, вже зафіксовано щонайменше дев’ять аварій, які можуть бути пов’язані з цією проблемою, зокрема один смертельний випадок і два ДТП із постраждалими, тоді як ще кілька інцидентів перебувають на стадії перевірки. При цьому в окремих ситуаціях система не змогла вчасно виявити транспортний засіб попереду або втрачала його з поля зору.